Güncelleme: REBUS 2.0 yayınlandı!

Entropi Toplaşması (ET) hayal edebileceğiniz en işe yarar algoritmadır. Atıf yapılmıyor ve kullanılmıyor çünkü oturmuş bilimsel paradigmalar onun anlamını kavrayamıyor.

Aslında fikir çok basit:

ET’de entropi ilgililik//ilgisizlik ölçüsü olur.

— Bloklarda bir arada beliren ya da bir arada kaybolan öğe altkümelerinin entropisi düşüktür: O öğeler birbiriyle “ilgili”dir: Harfiyen birbirlerine “ilişirler”.

— Bloklarda bir kısmı belirirken bir kısmı kaybolan öğe altkümelerinin entropisi yüksektir: O öğeler birbiriyle “ilgisiz”dir: Harfiyen birbirlerine “ilişmezler”.

Bunların hepsi James Joyce’un Ulysses’inin analiz sonuçlarında gözlenebilir: izdusum-entropisi.pdf

Böylece entropi bir ilgililik//ilgisizlik ölçüsü olur, harfiyen ve tanımı gereği: https://www.etimolojiturkce.com/kelime/ilgi

Kaynaklar:

I. B. Fidaner & A. T. Cemgil (2013) “Summary Statistics for Partitionings and Feature Allocations.” [Bölüntüler ve Özellik Atamaları için Özet İstatistikleri] In Advances in Neural Information Processing Systems (NIPS) 26. Paper: http://papers.nips.cc/paper/5093-summary-statistics-for-partitionings-and-feature-allocations (the reviews are available on the website)

Türkçesi: ozet-istatistikleri.pdf

I. B. Fidaner & A. T. Cemgil (2014) “Clustering Words by Projection Entropy,” [İzdüşüm Entropisi ile Sözcüklerin Öbeklenmesi] accepted to NIPS 2014 Modern ML+NLP Workshop. Paper: http://arxiv.org/abs/1410.6830 Software Webpage: https://fidaner.wordpress.com/science/rebus/

Türkçesi: izdusum-entropisi.pdf

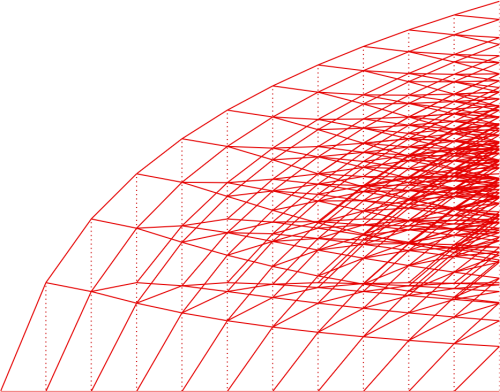

İmkânlı tüm entropi değerlerinin grafiği evrensel bir sabittir:

ET dendrogramlar üreten bir hiyerarşik öbekleme algoritmasıdır. Çıktılarının neye benzediğini göstermek için birkaç örneğim var:

Mycorrhizal mantar çalışmalarında bulunuşlarına göre

(I) bitkilerin (II) mantarların öbeklenmesi.

Kaydedilmiş fenotipik karaktarlerine göre dinozorların öbeklenmesi.

Verili bir dış gezegen kümesinde bulunuşlarına göre merkezî dalgaboylarının öbeklenmesi.

İyi bilinen Iris veri kümesinin öbeklenmesi. Çiçeklerin 145/150 tanesi başarıyla öbeklendi. (Bu son örnekte veri kümesindeki sayısal özellikleri kategorik özelliklere çeviren bir ek kod kullanıldı)